Meta, içerik üreticilerden gelen yoğun şikayetlerin ardından Facebook platformunda taklit (impersonation) hesaplarla mücadeleyi güçlendirecek yeni araçlar duyurdu. Şirket, özellikle yapay zekâ ile üretilen düşük kaliteli içeriklerin (“AI slop”) platform deneyimini olumsuz etkilemesi nedeniyle orijinal içerik üreticilerini korumaya yönelik adımlarını hızlandırıyor.

Meta’ya göre bu stratejinin temel amacı; orijinal içeriklerin görünürlüğünü artırmak ve üreticilerin gelir elde etme potansiyelini korumak. Aksi halde platformun creator ekonomisi açısından cazibesini kaybetme riski bulunuyor.

20 milyon sahte hesap kaldırıldı

Meta, geçen yıl boyunca toplam 20 milyon sahte veya taklit hesabı platformdan kaldırdığını açıkladı. Ayrıca büyük içerik üreticilerini hedef alan taklit şikayetlerinde %33 oranında düşüş yaşandığı belirtildi.

Şirket, önceki dönemde spam ve tekrar eden içeriklere karşı başlattığı mücadele kapsamında; başka üreticilerin fotoğraf, video veya metinlerinin yeniden paylaşılması gibi davranışları daha agresif şekilde filtrelemeye başlamıştı. Bu hamlenin etkisiyle 2025’in ikinci yarısında orijinal içerik izlenme süreleri ve görüntülenmeleri yaklaşık iki katına çıktı.

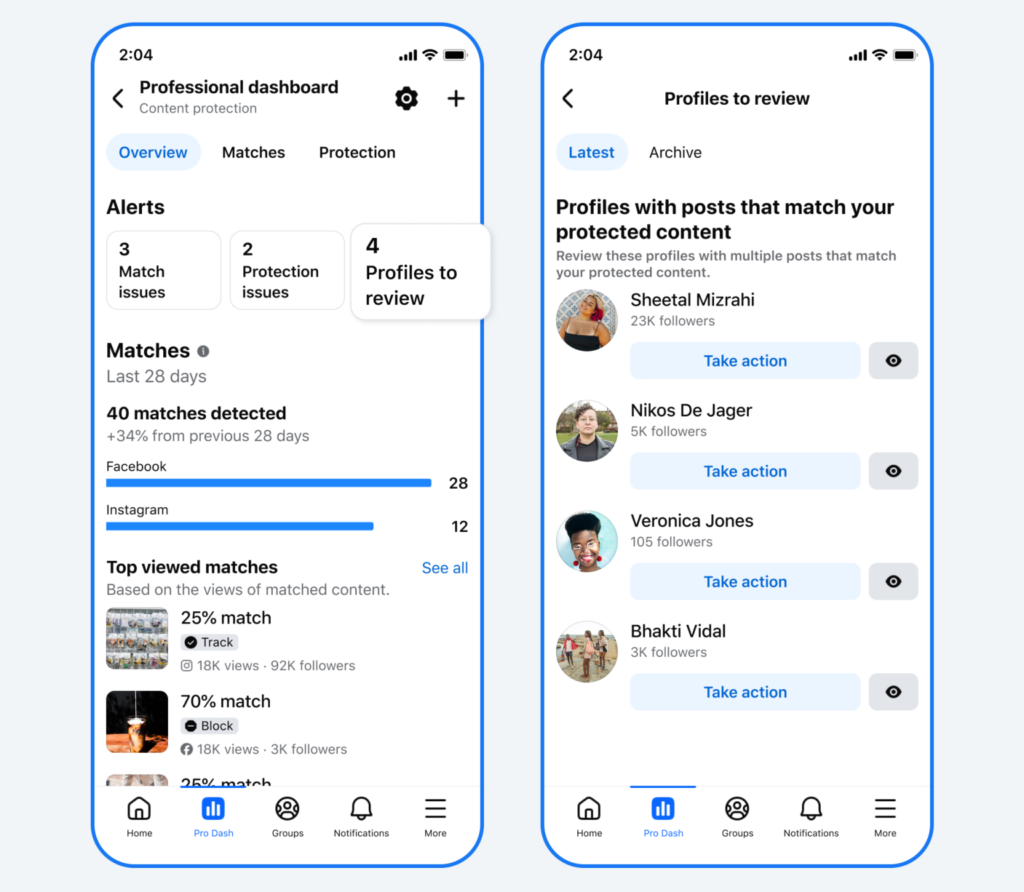

Yeni dashboard ile taklit içerik bildirimi tek merkezde

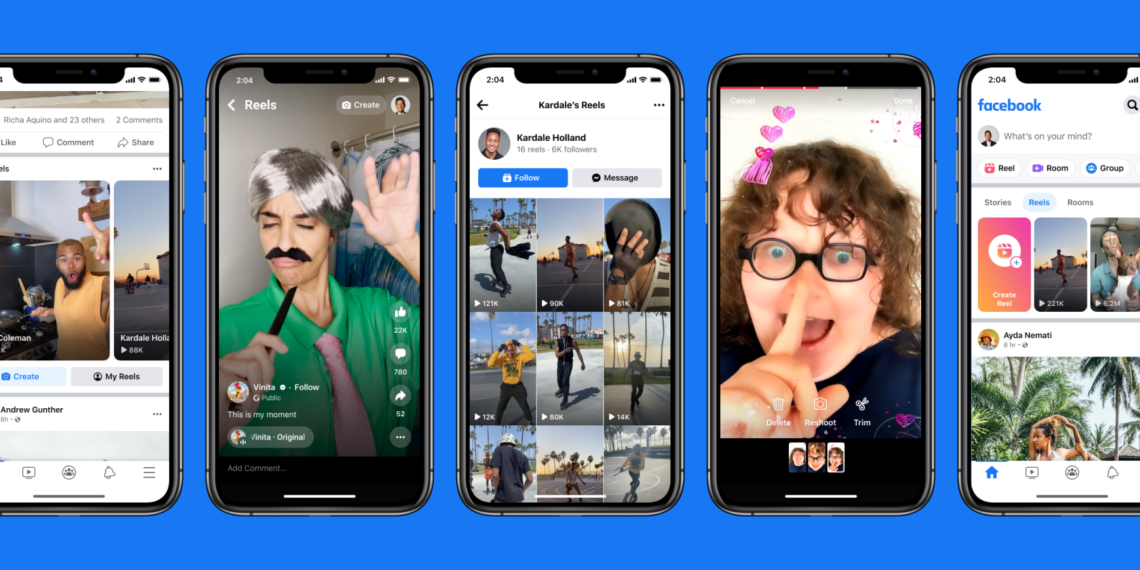

Facebook’un test ettiği yeni sistemle birlikte içerik üreticiler, reels videolarının taklit hesaplar tarafından yeniden paylaşıldığını tek bir kontrol panelinden tespit edip raporlayabilecek.

Yeni araçlar sayesinde:

- Taklit içerikler merkezi bir dashboard üzerinden işaretlenebilecek

- Bildirim süreci daha hızlı ve sade hale getirilecek

- İçerik koruma araçlarının platform genelinde daha etkin çalışması sağlanacak

Ancak Meta, mevcut sistemin şu an yalnızca kopya içerik eşleşmesi üzerine çalıştığını, üreticinin yüzünün veya kimliğinin izinsiz kullanımı gibi alanlarda geliştirme yapılması gerektiğini de kabul ediyor.

“Orijinal içerik” tanımı yeniden yazıldı

Meta ayrıca içerik politikalarını güncelleyerek “orijinal içerik” kavramını daha net tanımladı. Buna göre:

- Doğrudan üretici tarafından çekilen veya üretilen içerikler

- Remix, analiz veya yeni bilgi ekleyen yaratıcı dönüşümler

orijinal olarak kabul edilecek.

Buna karşılık yalnızca kenarlık eklemek, altyazı koymak veya küçük düzenlemelerle yeniden yüklemek gibi düşük değerli değişiklikler artık orijinal içerik sayılmayacak ve algoritmik olarak geri plana atılacak.

Platformlar arası rekabet kızışıyor

Meta’nın bu hamlesi, yapay zekâ çağında sosyal platformların içerik kalitesini koruma yarışının bir parçası olarak görülüyor. Benzer şekilde YouTube da kısa süre önce deepfake tespit araçlarını siyasetçiler, gazeteciler ve kamuya mal olmuş kişiler için genişlettiğini açıklamıştı.

Creator ekonomisinin büyümesiyle birlikte orijinallik, içerik güvenliği ve yapay zekâ kaynaklı risklerin yönetimi, platformların uzun vadeli başarısında kritik faktörler olmaya devam edecek.

FounderN Kimdir?

FounderN, girişimcilik dünyasının en güncel haberleri, inovasyon odaklı içerikleri ve ekosistemin her bir parçasına değer katan çalışmalarıyla, faaliyet gösteren dinamik bir dijital medya platformudur. 2020 yılında “Girişim Haberleri” adıyla başlayan serüvenimiz, Eylül 2024 itibarıyla FounderN kimliği ile, girişimcilik ekosisteminin ilham veren dinamik sesi olma yolculuğuna devam ediyor. FounderN; teknoloji, girişim ve yatırım dünyasındaki gelişmeleri yaratıcı ve yenilikçi bir perspektifle sunarak iş dünyasının liderlerini, yatırımcılarını ve girişimcilerini sizlerle bir araya getirir.

FounderN olarak misyonumuz, yalnızca yaşanan son gelişmeleri paylaşmak değil, okurlarımızı bu gelişmelerin aktif bir parçası haline getirmek ve ekosistemin sürdürülebilir büyümesine katkı sağlamaktır. Ekosistemdeki en yeni gelişmelerden haberdar olmak, büyüyen bu topluluğun bir parçası olmak istiyorsanız, bültenimize abone olabilir, sosyal medya hesaplarımızdan bizi takip ederek ilham dolu bu yolculuğa katılabilirsiniz.

Bizimle Keşfetmeye Devam Edin: İlginizi çekebilecek diğer #Teknoloji Haberleri için tıklayın!

Foundern LinkedIn hesabına buradan ulaşabilirsiniz.

Foundern Instagram hesabına buradan ulaşabilirsiniz.